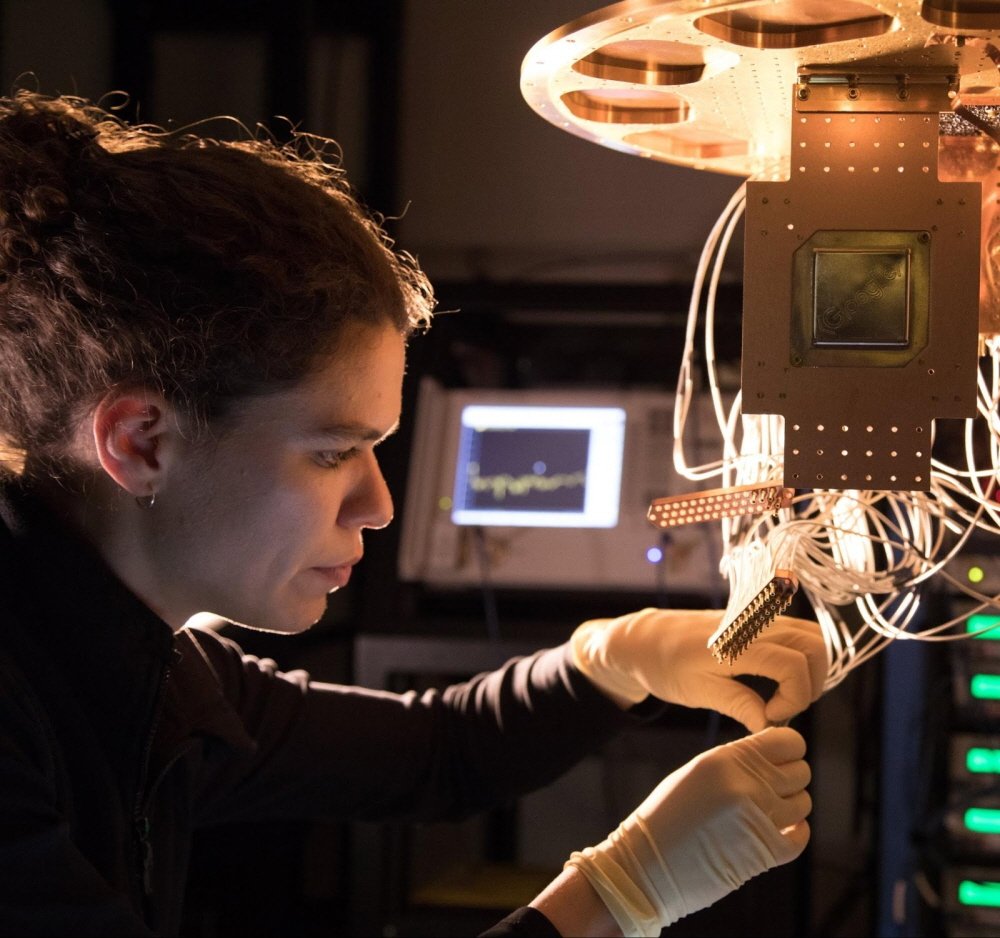

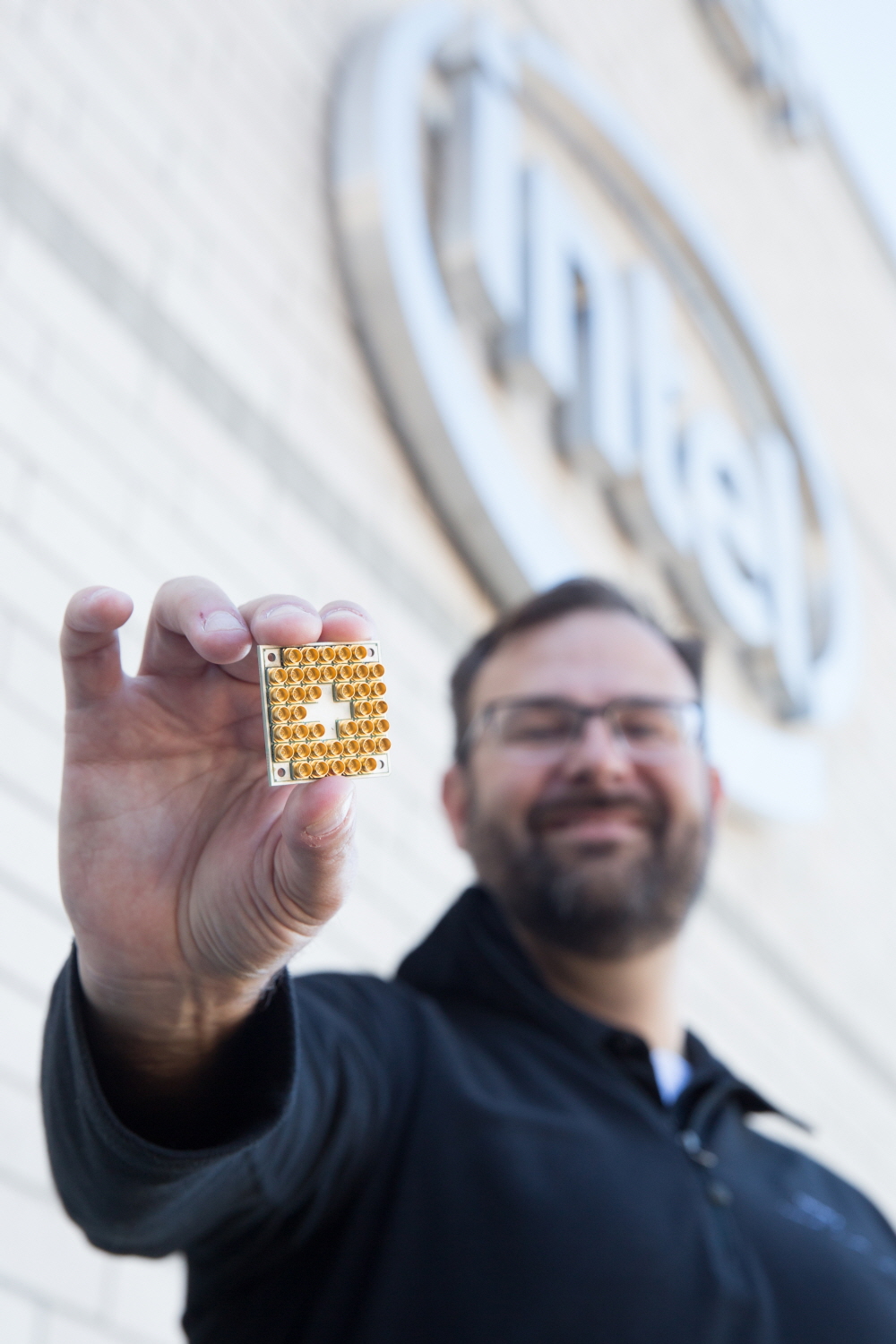

量子处理器时代开启了。谷歌于3月5日(当地时间)宣布推出量子处理器Bristlecone。普通PC处理器在1位中具有0或1状态。但是,Bryston配备了72个量子比特,它们同时叠加了0和1个信息。谷歌希望使用这些量子处理器能够使计算处理超越传统的计算限制。

谷歌一直瞄准量子计算机。谷歌自收购D-Wave以来一直在这种量子计算机技术的基础上进行开发,并且在2014年它一直在测试D-Wave 2的性能。然而,当时的性能与现有的没有差别。电脑。

量子计算机使用Qubit,它可以同时具有0和1。量子位数表示量子计算机的性能。但是,没有办法准确地观察量子位状态。为此,我们需要一个量子位来再次观察量子位状态。例如,具有2,000位公共加密密钥的RSA密码系统据说每天具有1亿个比特位,以使用Shor算法使用量子计算机对其进行解密。 1亿个量子比特中的大多数用于生成纠错和计算执行所需的特殊量子状态。为了解决这个问题,有必要提供大量量子位以减少计算处理中可能出现的量子比特误差。 Bryskon旨在为这些量子误码率和性能测量提供测试平台。它还可以用于量子模拟和机器学习。

根据谷歌的说法,在一个量子比特误差率为0.1%,两个量子比特为0.6%,在读取时使用1%量子门的逻辑运算。 Bryshon采用了相同的读取和逻辑运算处理方法,具有72个量子位。谷歌表示它需要49个量子比特才能成为量子超级大国,量子计算机可以在这个状态下进行超出传统计算限制的计算处理。但是使用Britschon的72 kBits,它可能可以适应未来的技术挑战。

谷歌发布了BrysCon,以表达对量子计算机和量子超越的未来的信心。然而,为了在未来实现这种量子计算,开发软件需要更多的时间,因为它需要各种连接。

尽管围绕量子计算机没有争议,但摩尔定律自2015年以来一直受到限制,因此高速处理技术受到限制,数字数据由现有计算机等众多的0和1组成。有必要记住有。

现有计算机的组件很简单。存储设备,算术设备和控制设备。计算机具有芯片模块,基础模块,逻辑门和晶体管。晶体管是简单的开关。它用于删除或停止信息。这里流动的信息是众所周知的最小位单位,其值为0或1.该位只能是0或1.但是,有几个简单的结构可以表示更复杂的信息。

逻辑门也执行简单的计算。例如,如果AND门全为1,则可以将其作为1发送,否则它是一个发送0的简单配置。但是,如果将它们组合在一起,则可以执行可以添加或相乘的所有计算。从这个角度来看,即使是高端电脑似乎也在收集7岁的孩子。但随着这些数字的增加,物理和复杂的3D游戏变得可用。

晶体管是电气开关。电流和电子通过开关运动。如果晶体管制造工艺是14nm,它只是HIV病毒大小的八分之一。它大约是红细胞的500分之一。问题越小,隧道效应越可能导致泄漏。最终,当前的技术将在某一天达到物理极限。

期望量子计算机通过同时利用0和1的特性来实现不同级别的处理速度。现有计算机基本上是处理器数量和它们实际处理的处理能力之间关系的单一比例。然而,理论证明量子计算机的容量呈指数增长。正因为如此,我们期望量子计算机成为开启下一代技术的突破。

例如,假设您正在寻找数据库。如果要搜索数据库,搜索必须引用所有元素,因此需要花费一些时间逐个查找和显示数据。但是,如果您是量子计算机,则可以在平方根时间内进行搜索。换句话说,如果它是一个花费一百万秒的搜索,它可以在1000秒内结束。同样,可以预期在模拟中需要大量计算的领域中使用它。

科学家Nature表示,2017年量子计算机将从2017年开始从研究转向开发。事实上,IBM还宣布推出IBM Q( http://research.ibm.com/ibm-q/ )服务,该服务允许用户使用在同年3月试验基于云的量子计算。英特尔还表示,它已于2017年成功生产出具有17个量子比特的原型超导芯片。

但是,如上所述,实际实现仍存在许多障碍。使用0和1的量子计算机同时使用量子叠加和量子纠缠效应提供大规模并行处理。 (量子位可以同时存在两种状态,而不是一种状态,称为叠加。在现有计算机的情况下,4位信息只能代表15种类型中的一种,但量子位可以显示全部16种。同时,随着数量的增加呈指数增长。量子纠缠是两个量子比特彼此分离的现象,但同时它们处于相同的状态。

当多量子位的并行处理保持在量子干扰状态时,重要的是什么。为了使用量子比特精确计算,重要的是它们是否处于不相互干扰的相干状态。如果你不保留这个,你将无法得到答案,因为它会影响彼此的量子状态。

到目前为止,使用当前的技术,这种一致的状态只能持续一秒钟。如果你看一下每秒处理超过1亿次的计算时间,1秒的时间当然是相当长的。但克服这些不稳定性也是量子计算机可靠性的最大挑战。

此外,还存在一些原则上无法从外部衡量的矛盾。这是由于当测量量子态时状态改变的原理特征。这是一个令人讨厌的问题,原则上无法确定它是否正常工作。设计用于解决此问题的方法是将量子位乘以其他量子位以间接检查量子位状态。

然而,这种方法需要更多的量子比特,因为它需要使用其他量子比特来增加复杂量子比特的可靠性。要测量单个计算并提高性能,可能需要几百到多达一个量子位的10,000倍。最终,在此过程中发生的错误率极大地限制了量子计算机可以运行的计算时间。

它不是修复错误,而是设计用于防止错误或忽略错误效果。但是,如果它成为没有纠错功能的设备,则可能导致无法获得超过现有计算机的结果的问题。如果量子计算机处于发生大量错误的阶段,则不能说它优于现有计算机。另外,如果在该过程中量子比特的数量增加,则存在整个计算机消耗的功率增加的问题。

另一方面,考虑通过无条件地增加量子位的数量来提高算法效率而不是解决问题。为了使量子计算机准确计算,它必须在保持一致状态的同时完成处理。这里重要的是如何使用算法有效地完成计算。无论如何,似乎需要更多时间来解决这些技术挑战。

随着谷歌推出量子处理器,量子计算的新电力将有可能被打开。可以说,存在一致地构建整个量子计算系统的基础,例如用于控制量子计算的硬件和体系结构以及用于量子计算的软件。

Add comment