在2018年6月,谷歌收到参与美国国防部(AI)使用项目的员工的抗议,并发布了人工智能使用指南。谷歌全球运营高级副总裁肯特沃克在3月26日的官方博客中表示,“我们将设立一个外部咨询委员会,以通过内部公司治理和流程来补充这一原则。”

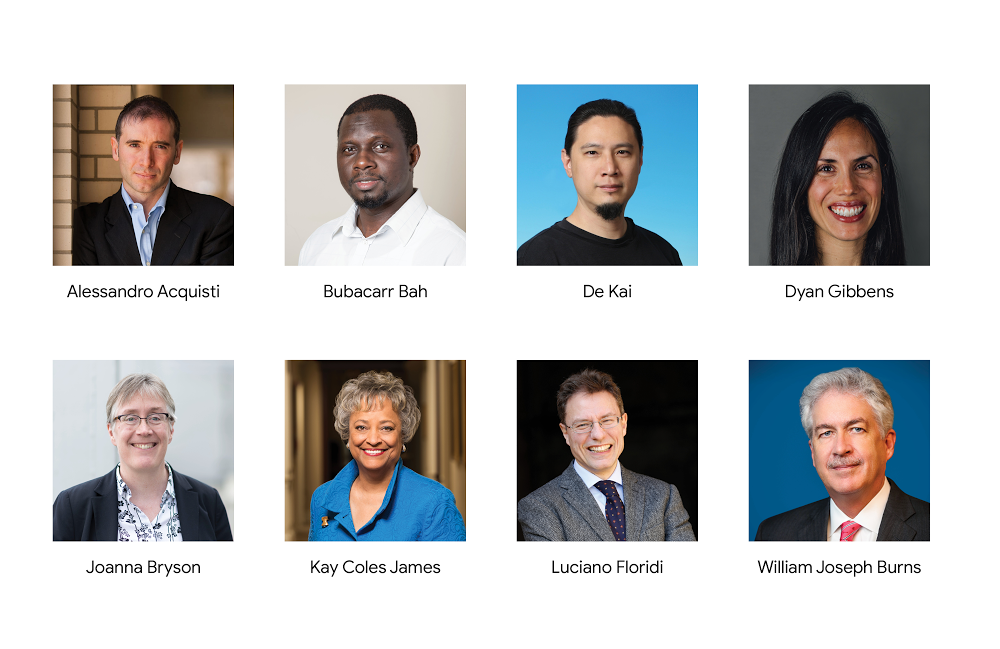

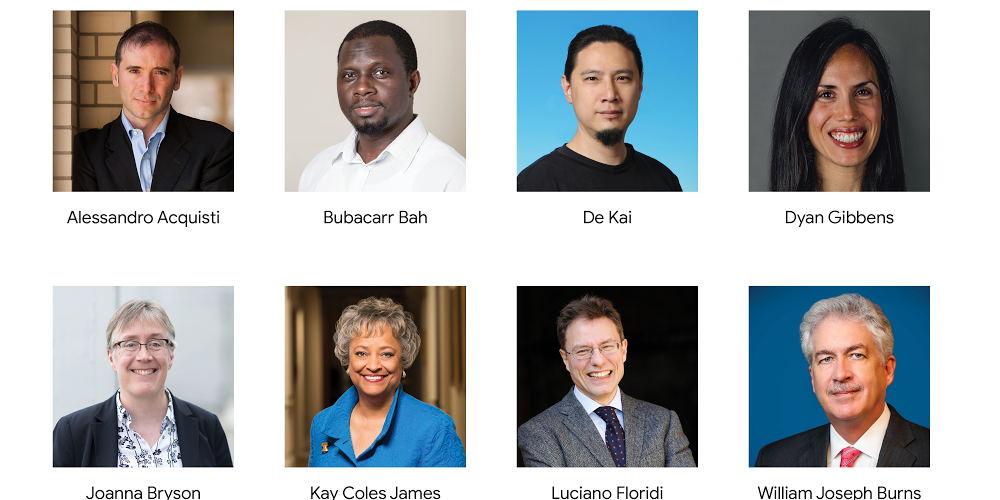

咨询委员会旨在提供有关Google工作的各种观点,同时审查人工智能原则(如人脸识别和机器学习公平)引起的复杂问题。咨询委员会的成员由各种知识分子命名,包括机器学习研究人员,数字伦理和外交政策专家。行为经济学家Alessandro Acquisti;德凯,自然语言处理和机器学习研究员; Dyan Gibbens,工业工程和无人机系统专家;凯尔科尔斯詹姆斯,公共政策专家;和外交家威廉约瑟夫伯恩斯。

他们计划在今年年底前与ATEAC委员会举行四次会议。他计划参与实际的Google开发流程,并提交一份总结讨论情况的报告。 “负责任的人工智能开发认识到很多人会对各个领域感兴趣,”沃克说。 “我们将与ATEAC专家以及世界各地的合作伙伴和组织进行交流。”我会听取各种声音以及咨询委员会的意见。

谷歌宣布其人工智能使用道德准则正在由数十名抗议者和戒烟者传播,因为众所周知他们是美国国防部项目Maven的一部分。虽然军事项目的合同金额很大,但公司的基本面都是优秀的人才和大脑。为了保持高科技公司,可能有必要保持不使用人工智能武器的原则,并保持谷歌原来不做恶的原则。欲了解更多信息,请点击这里 。

Add comment